數(shù)月前開始,關(guān)于“AI換臉“的話題時(shí)不時(shí)地登上熱搜,網(wǎng)友們一邊對(duì)這一科技大法,一邊調(diào)侃XX明星的演技。

按理說,科技為大眾帶來娛樂的祥和氛圍挺好的,不過,是時(shí)候換個(gè)角度來看看這種技術(shù)帶來的一些偏門應(yīng)用。

網(wǎng)上熱傳的換臉神器,是一種利用更深度學(xué)習(xí)技術(shù)識(shí)別和交換圖片、視頻中人物臉部圖像的工具,被稱為深度偽造,也就是,它不僅制作過程簡(jiǎn)單而且逼真度驚人。

普通大眾接觸到的已經(jīng)是通過它制作出來的成品,比如徐錦江版的海王、復(fù)活的張國(guó)榮,被楊冪版黃蓉。

在出現(xiàn)前,視頻換臉技術(shù)最早最廣泛的應(yīng)用還是在電影領(lǐng)域,那時(shí)它需要相對(duì)較高的技術(shù)和資金。

現(xiàn)在降低了這一門檻報(bào)錯(cuò)己阻擊應(yīng)用程序?qū)D像,它真正廣泛出現(xiàn)在大眾視野里是因?yàn)樯狭餍械南盗幸曨l。

算法的偏門應(yīng)用

最初一些少數(shù)技術(shù)精英們,為了傳播技術(shù)在上創(chuàng)辦了論壇。

不過在討論技術(shù)學(xué)習(xí)的路上,的黑暗面逐漸顯露報(bào)錯(cuò)己阻擊應(yīng)用程序?qū)D像,大家發(fā)現(xiàn)這種換臉技術(shù)還有一個(gè)細(xì)分方向:滿足私欲。

由推動(dòng)的色情生意病態(tài)發(fā)展,訂制色情片泛濫,從明星到路人,后來還延伸到了色情復(fù)仇。

的色情生意并不是“隔海相望”,這種色情交易早已蔓延到國(guó)內(nèi),成為隱形的地下生意。

的技術(shù)應(yīng)用開發(fā)并未止步于色情視頻換臉。

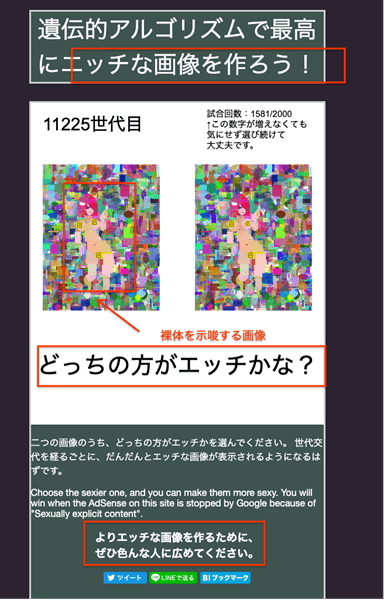

據(jù)美國(guó)科技媒體 6月27日?qǐng)?bào)道,一名程序員又開發(fā)了名為“”的應(yīng)用,上傳一張女性照片,神經(jīng)網(wǎng)絡(luò)技術(shù)可“自動(dòng)”脫掉她的衣服。

這個(gè)軟件目前只能處理女性的照片,裸露越多,處理效果越好。上傳男性照片依然會(huì)被處理替換成女性身體,卡通圖片則無法識(shí)別。

開發(fā)此款應(yīng)用的程序員表示,該應(yīng)用由其開發(fā)的開源算法創(chuàng)建,這一算法與之前的人工智能換臉技術(shù)算法相似,只用了1萬張女性的裸照進(jìn)行訓(xùn)練,之后會(huì)考慮創(chuàng)建男性版本,而繼續(xù)這個(gè)實(shí)驗(yàn)的也是為了在這個(gè)算法上獲得經(jīng)濟(jì)回報(bào)。

顯然,在侵犯著眾人隱私,甚至將每個(gè)人暴露在色情報(bào)仇的危險(xiǎn)之中,而女性成為首個(gè)被攻擊的群體。類似的算法偏門應(yīng)用可能還會(huì)不斷出現(xiàn),的開發(fā)依舊離不開生理需求的主導(dǎo)。

反識(shí)別提上日程

可悲的是,無數(shù)關(guān)乎女性的系列應(yīng)用和視頻并未能讓大眾產(chǎn)生危機(jī)感,當(dāng)換臉視頻波及到更廣泛的人物,成為篡改視頻的技術(shù)手段,進(jìn)而萌生技術(shù)犯罪趨勢(shì)的時(shí)候,大家才開始慌張。

想要得到一個(gè)換臉視頻并不復(fù)雜,例如圖中希拉里版特朗普的視頻僅使用了一種名為的軟件,放入圖片視頻即可一鍵生成,不懂編程的人閱讀操作流程后都可輕易上手。

對(duì)此,美國(guó)《通信規(guī)范法》第230條:“交互式計(jì)算機(jī)服務(wù)提供者或使用者,就非出于己的信息內(nèi)容,不應(yīng)被視為內(nèi)容的出版人即發(fā)表人。”這條規(guī)則可能要因?yàn)槎淖儭?/p>

美國(guó)國(guó)防高級(jí)研究計(jì)劃局為此設(shè)立了“媒體鑒證”項(xiàng)目,以開發(fā)能識(shí)別的工具,項(xiàng)目最初旨在實(shí)現(xiàn)現(xiàn)有鑒證工具的自動(dòng)化,后來將終點(diǎn)轉(zhuǎn)向了人工智能生成的虛假視頻上。

由到鑒別制造的虛假視頻,展開了一場(chǎng)“貓和老鼠”的技術(shù)追擊戰(zhàn)。

近期,加州大學(xué)伯克利分校和南加州大學(xué)的研究人員打造的AI識(shí)別系統(tǒng)可尋找每個(gè)人的“軟性生物識(shí)別”標(biāo)簽,在這場(chǎng)博弈賽中取得了階段性的取勝。

雖然,技術(shù)發(fā)展迅猛,此前“無法眨眼”的問題已經(jīng)得到改善,但研究人員發(fā)現(xiàn),人們?cè)谡f話時(shí)產(chǎn)生的頭、手、眼睛、嘴唇的微妙變化是在創(chuàng)造虛假視頻時(shí)暫未考慮到的元素。

背后的原理為,不同人在說話時(shí)會(huì)表現(xiàn)出相對(duì)不同的面部和頭部運(yùn)動(dòng)模式,由模仿算法控制會(huì)打破這些模式,導(dǎo)致嘴巴與頭部面部等部分形成不自然的分離。

基于此,這項(xiàng)鑒別技術(shù)構(gòu)建了高度個(gè)人化的“軟生物識(shí)別指標(biāo)”。檢測(cè)實(shí)驗(yàn)中,該鑒別技術(shù)的總體識(shí)別率超過了95%。

接下來,研究人員將著手聲音特征進(jìn)一步提高AI識(shí)別假視頻的技術(shù)。

▲基于希拉里(棕)、奧巴馬(淺灰?guī)Э颍⑸5滤梗ňG)、特朗普(橙)、奧倫(藍(lán))隨即任務(wù)(粉)、奧巴馬假視頻(深灰?guī)Э颍┑?90-D特征的而為可視化散點(diǎn)圖。

這只是博弈中,鑒別技術(shù)的一個(gè)短暫領(lǐng)先,軟生物識(shí)別指標(biāo)的可靠性一定程度上仍然會(huì)受各類元素的影響,例如背景環(huán)境、鏡頭位置等。在這方面造假技術(shù)很可能又會(huì)迎頭趕上,更多基于算法的新應(yīng)用又會(huì)出現(xiàn),例如前面提到的。

在這場(chǎng)復(fù)雜程度不斷增加的安全博弈中,攻擊會(huì)被防御反擊,反過來又被更復(fù)雜的攻擊所抵消。

從國(guó)外引起的女性隱私侵犯,到國(guó)內(nèi)有B站泛濫的明星換頭惡搞視頻,我們正在為破壞的秩序付出代價(jià)。

的損害不只是換臉

在AI深度學(xué)習(xí)第一個(gè)站出來給自己一巴掌的,是被稱為亞洲四大邪術(shù)的。

Adobe在6月中旬推出了反PS工具。依托于AI算法,這個(gè)工具目前僅支持用于識(shí)別經(jīng)液化處理圖片,可自動(dòng)識(shí)別出人像照片中被修改的部分,還能把它還原成到初始樣貌,準(zhǔn)確率高達(dá)99%。

此前Adobe也公布過識(shí)別圖片是否經(jīng)過拼接、復(fù)制、刪除的AI。

這次研究人員通過編寫腳本簡(jiǎn)歷大量圖像訓(xùn)練集,通過網(wǎng)絡(luò)上抓取的圖片使用面部感知液化調(diào)整,隨機(jī)選擇這些照片的子集進(jìn)行訓(xùn)練。同時(shí)還聘請(qǐng)藝術(shù)家改變相關(guān)參數(shù)到數(shù)據(jù)集中。

Adobe表示,這項(xiàng)研究成果并不會(huì)立即轉(zhuǎn)變?yōu)樯虡I(yè)產(chǎn)品,只是為更好地監(jiān)測(cè)圖像、視頻、音頻做出的一步努力。

其官網(wǎng)給出了更明確的解釋:

Adobe為用戶提供工具,釋放想象力,讓他們將想法變?yōu)楝F(xiàn)實(shí),對(duì)此我們對(duì)Adobe作為創(chuàng)意工具在世界上的影響力感到自豪,但同時(shí)也意識(shí)到這項(xiàng)科技延伸的潛在道德問題。虛假內(nèi)容已經(jīng)成為日益緊迫的嚴(yán)重問題。

Adobe所指的虛假內(nèi)容,影射的正是。在建立機(jī)器學(xué)習(xí)應(yīng)用后,需要確保它足夠安全,AI 里的急需另一個(gè)AI來鉗制,然而現(xiàn)實(shí)里的鑒別速度永遠(yuǎn)要比造假慢幾拍,我們已經(jīng)生活在一個(gè)安全問題暴露的世界里。

而深度偽造技術(shù)存在的真正損害,不止是隱私侵犯、數(shù)據(jù)盜竊、色情內(nèi)容亦或是政治上,它正在加速挑戰(zhàn)著互聯(lián)網(wǎng)數(shù)據(jù)真實(shí)性的邊界。

想象一下,未來無數(shù)機(jī)器學(xué)習(xí)分析的很可能來源于的假數(shù)據(jù),它的存在是對(duì)虛擬的網(wǎng)絡(luò)世界里關(guān)于“真實(shí)”最迫在眉睫的威脅,而這種影響可能用各種對(duì)抗識(shí)別鑒定方法都難以彌補(bǔ)。

今天有人有興致把朱茵的黃蓉?fù)Q成楊冪的臉,以后就不好說了。